Você tem um time pronto para treinar modelos, um backlog de experimentos e um prazo que não aceita improviso. Aí começa o ciclo conhecido: escolher GPU, estimar energia e refrigeração, decidir storage, montar rede, padronizar drivers, fechar versões de CUDA, resolver gargalo de I/O, integrar com o diretório corporativo, criar políticas de acesso e, só então, rodar o primeiro treino. Em muitos grupos de P&D e laboratórios, esse caminho consome semanas ou meses – e o custo real aparece como atraso de pesquisa, fila parada e equipe sênior virando “suporte de cluster”.

Infraestrutura de IA pronta para uso existe para cortar esse tempo morto. Não é “caixa mágica”. É um conjunto de decisões de arquitetura, integração e operação que já vem fechado, validado e entregue com foco em produzir resultado desde o primeiro dia.

O que é infraestrutura de IA pronta para uso (e o que não é)

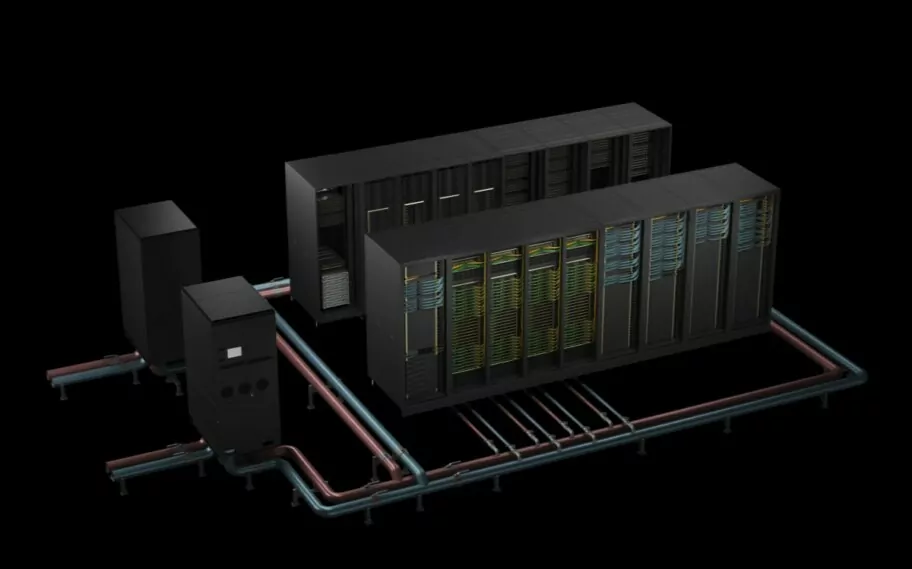

Infraestrutura de IA pronta para uso é um ambiente computacional entregue com hardware, software base e integrações essenciais já configurados para workloads de IA. A meta é reduzir o tempo entre a chegada do equipamento e o início de treinos, inferência e pipelines de dados com desempenho previsível.

O que isso inclui varia conforme o caso, mas normalmente envolve servidor(es) com GPU, rede e armazenamento dimensionados para o perfil do laboratório, além de uma camada operacional mínima: sistema operacional, drivers, bibliotecas, orquestração (quando necessária), monitoramento, controle de acesso e rotinas de manutenção.

O que isso não é: um atalho para não pensar em dados, MLOps ou qualidade de dataset. Também não resolve, sozinho, problemas de governança e compliance. O “pronto para uso” reduz o esforço de infraestrutura e padroniza a base – mas as decisões de ciência de dados e do ciclo de vida do modelo continuam sendo responsabilidade do time.

Por que a infraestrutura vira gargalo em IA aplicada e pesquisa

Em IA, o gargalo raramente é só “falta de GPU”. O que travou seu throughput em treino no último trimestre provavelmente foi uma combinação de detalhes operacionais.

O primeiro é o acoplamento entre software e hardware. Versões de driver, CUDA, framework e bibliotecas (PyTorch, TensorFlow, NCCL, cuDNN) precisam estar consistentes com o modelo de GPU e com o método de treino (single node, multi-GPU, multi-node). Um pequeno desalinhamento vira instabilidade, queda de performance ou dias perdidos em debug.

O segundo é o caminho dos dados. Em muitos casos, o treino não está 100% ocupado na GPU porque o pipeline de leitura e pré-processamento não acompanha. Storage inadequado, rede subdimensionada, muitos arquivos pequenos, falta de cache, dataset em formato pouco eficiente – tudo isso derruba utilization e alonga o tempo até resultado.

O terceiro é a operação. Sem monitoramento e boas práticas de agendamento, você não sabe se o cluster está ocioso, saturado em I/O ou limitado por memória. E, sem políticas claras, a disputa por recursos vira ruído entre times.

Infraestrutura pronta para uso ataca exatamente esse conjunto: padroniza o stack, entrega uma arquitetura equilibrada e estabelece um modo de operação que reduz variação e risco.

O que define “pronta para uso” na prática

A avaliação é simples: depois da entrega, em quanto tempo seu time consegue iniciar um treino reproduzível e coletar métricas confiáveis? Para chegar perto do “dia 1”, alguns elementos precisam estar resolvidos.

Base de software validada, não apenas instalada

Instalar driver e framework é o começo. O que evita dor é validação: testes de estabilidade, verificação de performance mínima esperada, checagens de comunicação entre GPUs, e confirmação de que o ambiente se mantém consistente após atualizações controladas.

Isso reduz o risco de “funciona no notebook do pesquisador, falha no servidor” e cria um baseline que facilita comparar experimentos.

Storage e rede dimensionados para IA, não só para arquivo

Para IA, throughput e latência de leitura importam tanto quanto capacidade. Se o dataset cresce e o pipeline muda (por exemplo, mais augmentations), o perfil de I/O muda. Uma infraestrutura pronta para uso considera o tipo de acesso (sequencial vs aleatório), quantidade de arquivos, necessidade de cache e a taxa de alimentação necessária para manter GPU ocupada.

Em ambientes multiusuário, rede e storage também precisam suportar concorrência sem degradação imprevisível. Isso é o que separa “tem GPU” de “tem produtividade”.

Controle de acesso e isolamento operacional

Laboratórios e áreas de inovação costumam lidar com dados sensíveis, IP e parcerias. O ambiente pronto para uso precisa nascer com autenticação e autorização bem definidas, segregação entre projetos quando necessário e trilhas mínimas de auditoria. Sem isso, a infraestrutura vira um risco para a área de pesquisa e para a TI.

Observabilidade e suporte com foco em desempenho

Quando um treino fica 30% mais lento, o problema pode ser thermal throttling, saturação de I/O, fragmentação de storage, memória insuficiente, configuração de dataloader, ou disputa de rede. Monitoramento e diagnóstico são parte do “pronto para uso”, porque mantêm o ambiente útil ao longo do tempo, não só no dia da entrega.

Onde a infraestrutura pronta para uso ganha de um build interno

Montar internamente pode fazer sentido quando existe uma equipe com experiência específica em HPC/IA e quando o custo de oportunidade é baixo. O ponto é que, na maioria dos grupos de P&D, esse não é o cenário.

A vantagem mais direta do pronto para uso é reduzir tempo até compute. Você elimina a fase longa de tentativa e erro e chega rápido ao que importa: experimentos, iteração e publicação ou entrega para produção.

A segunda vantagem é previsibilidade. Um ambiente entregue e validado tende a ter menos variação de performance e menos “incêndios” de compatibilidade. Isso é relevante para times que precisam comparar resultados ao longo de meses.

A terceira é operacional: menos dependência de uma pessoa específica. Em muitos laboratórios, o conhecimento do ambiente fica concentrado e, quando alguém muda de equipe, a infraestrutura “fica sem dono”. Pronto para uso bem entregue vem com documentação, padronização e suporte.

O trade-off real é flexibilidade. Se seu time quer experimentar stacks muito específicos, mexer em kernel, testar versões instáveis de driver ou customizar rede em profundidade, um ambiente padronizado pode impor processos de mudança mais cuidadosos. Para pesquisa exploratória de baixo risco, isso pode parecer “lento”. Para pesquisa mission-critical, é exatamente o que reduz downtime.

Como decidir se “pronto para uso” é a escolha certa

A decisão depende menos de orçamento e mais de impacto do tempo e do risco.

Se você tem prazo de projeto, contratos de P&D, ou uma agenda de entregas que depende de throughput constante, o pronto para uso costuma pagar rápido. Cada semana perdida em setup pode custar mais do que a diferença entre um desenho artesanal e um ambiente validado.

Se o ambiente será multiusuário e vai atender diferentes linhas (visão computacional, LLM, simulação com IA, otimização), padronização e governança deixam de ser “nice to have” e viram requisito.

Se o seu maior problema hoje é fila, conflitos por recurso e baixa utilização de GPU por gargalo de dados, o pronto para uso precisa ser especificado olhando o pipeline completo, não só a GPU. Caso contrário, você compra aceleração e continua limitado por storage.

E se você está em uma fase inicial, com um ou dois pesquisadores e workloads pequenos, talvez faça sentido começar menor, com uma workstation bem dimensionada e evoluir para cluster quando houver tração. “Pronto para uso” não significa necessariamente “grande” – significa adequado e operacional.

O que pedir em uma proposta de infraestrutura de IA pronta para uso

Para evitar surpresas, vale orientar a conversa por evidência e critérios de aceite.

Peça que o fornecedor descreva quais workloads foram considerados (treino, fine-tuning, inferência, pré-processamento), quais metas de desempenho orientaram o dimensionamento e como será feita a validação. Pergunte como ficam atualizações do stack de GPU, como é tratada a compatibilidade de frameworks e qual é o plano para crescimento de dataset.

Também vale alinhar desde o começo como será o acesso dos usuários, como os projetos serão separados e quais métricas você terá para acompanhar uso real: ocupação de GPU, throughput de storage, fila, falhas e tempo médio de resolução.

Se a sua organização tem exigências de segurança, inclua isso no escopo: integração com diretório, políticas de senha, segmentação de rede e retenção de logs. Em pesquisa, retrabalho por falta de compliance custa caro.

Modelos de entrega: compra, cluster, nuvem privada e locação

“Pronto para uso” aparece em formatos diferentes.

Uma workstation de IA pode ser o caminho mais rápido para um time pequeno rodar experimentos locais com alta performance e menos dependência de fila. Um servidor com múltiplas GPUs atende um grupo maior, com melhor aproveitamento e possibilidade de padronizar ambientes.

Quando o volume cresce, clusters e ambientes de nuvem privada entram para organizar múltiplos nós, usuários e projetos, com agendamento e políticas de uso. Para algumas organizações, hiperconvergência e storage corporativo integrado reduzem o atrito com a TI e simplificam expansão.

E existe um ponto prático: locação de servidores e desktops. Para projetos com pico de demanda, ou quando a compra é lenta, locar compute reduz o tempo de espera e evita travar o cronograma. Funciona bem quando o objetivo é acelerar pesquisa agora e decidir a expansão permanente com dados de uso real.

Onde a Scherm entra nesse cenário

Quando o objetivo é receber um ambiente que roda imediatamente e segue estável com suporte especializado, a Scherm entrega infraestrutura de HPC e IA pronta para uso com arquitetura, instalação e sustentação, incluindo a parte que costuma consumir tempo interno: integração, validação e operação orientada a desempenho.

Se a sua equipe está gastando mais energia “fazendo a máquina existir” do que treinando modelos e produzindo pesquisa, vale transformar a conversa em requisitos claros e critérios de aceite. O ganho não é só velocidade – é continuidade: menos interrupções, menos retrabalho e mais previsibilidade para o que realmente move P&D.

Feche a decisão com uma pergunta simples para o seu contexto: qual é o custo de mais um mês de setup, comparado ao valor de um mês a mais de experimentos bem executados e mensuráveis?